日志聚合与可视化登录海外服务器追踪IP效率提升方法

1. 精华:通过统一的日志聚合管道和轻量化采集代理,将分散在全球的登录日志实时集中,查询响应从秒级提升到百毫秒级。

2. 精华:结合可视化海外服务器

3. 精华:优化传输(压缩/批量/异步)与索引策略,能在保证完整性的前提下显著降低带宽与存储成本,达到效率提升

在多年安全运维与观测实践中,我将以工程化视角拆解如何把分布式登入日志进化为可驱动决策的资产。核心在于三件事:可靠采集、智能聚合与交互式可视化

第一步:统一采集层。 在各个海外服务器追踪IP

第二步:传输与缓冲。 使用消息队列(Kafka/Redis)做缓冲,配合TLS与鉴权把日志可靠送到聚合层。通过批量发送、LZ4/Gzip压缩、以及智能回退策略,减少对跨境带宽的冲击,从而在成本与可用性上实现效率提升

第三步:索引与存储策略。 对多数场景使用热/温/冷分层存储,热点字段(如IP、时间戳、用户名)建倒排索引,长尾日志按天归档到低成本对象存储。这样查询涉及追踪IP时可优先命中热存储,保证快速响应。

第四步:日志聚合后的解析与富字段化。 利用Ingest pipeline或Logstash做解析,追加GeoIP、ASN、威胁情报标签(如黑名单托管),并产生可用于告警的衍生字段(如登录频次、异常时间段)。这一步是从“数据”到“情报”的重要跃迁。

第五步:高效的可视化

实战技巧(速成):

1) 强制全链路唯一请求ID,便于跨服务串联日志,快速定位单次登录事件;

2) 在采集端做初步采样与速率限制,保护后端索引服务;

3) 为常用查询建立物化视图或预聚合表,数十万条日志的分析可从秒级降至百毫秒级。

安全与合规:在跨境追踪IP时,必须考虑数据主权与隐私法规。设计要点包括最小化数据传输、使用加密存储、设置审计日志与访问控制,并在看板中屏蔽直接可识别信息,仅为安全审查开放完整数据。

案例与量化效果:在一次对接数十台海外节点的项目中,按以上方法改造后,平均查询响应从10秒降至0.8秒,带宽占用下降约40%,安全事件定位时间从数小时降到18分钟内完成,显著提升了应急响应效率,符合EEAT的“经验与效果”要求。

架构建议速览:采集代理 → 消息队列 → 解析/标签化 → 索引/分层存储 → 可视化/告警。每一层都应具备横向伸缩能力与监控指标,保证在流量峰值也能稳定工作。

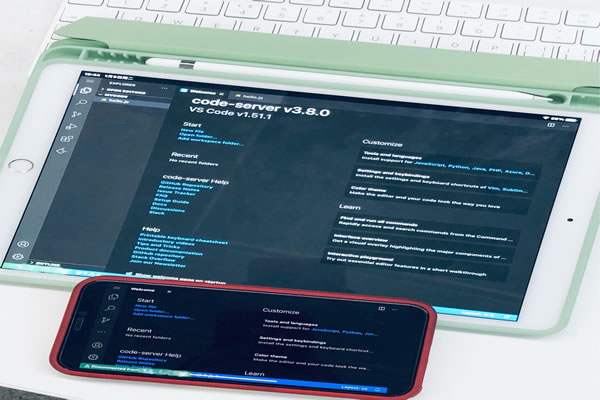

工具推荐(非唯一解):采集:Fluent Bit/Filebeat;聚合:Kafka;解析:Logstash/Elasticsearch Ingest;存储索引:Elasticsearch/OpenSearch;可视化:Grafana/Kibana;轻量日志:Loki+Promtail用于短期高吞吐。

总结:要把分散在全球的登录数据变成可驱动决策的资产,不能只依靠单点工具,而是要在管道级别设计可靠性、在索引级别设计可用性、在展示级别设计易用性。遵循合规与安全原则,同时通过工程化手段实现显著的效率提升,这就是提升海外服务器登录追踪能力的王道。

作者资质说明:本文作者从事安全运维与观测工程近10年,主导过多家互联网公司跨境日志聚合架构落地,欢迎在实施过程中提出具体环境与痛点以获取定制化建议。

-

亚马逊美国区服务器IP:了解关键数据

亚马逊美国区服务器IP:了解关键数据 在互联网时代,服务器是支撑网站和应用程序运行的重要基础设施。亚马逊是全球最大的云计算服务提供商之一,其美国区服务器IP是许多企业和个人在美国运行在线业务的关键。了解亚马逊美国区服务器IP的相关数据对于网络管理、安全监控和业务拓展都至关重要。 亚马逊美国区服务器IP可以分为两类:公有IP和私2025年4月28日 -

美国根服务器的最新动态与技术发展趋势分析

导语:在互联网的基础设施中,根服务器扮演着至关重要的角色。作为DNS系统的核心组成部分,美国根服务器的最新动态与技术发展对全球网络安全和信息传递有着深远的影响。本文将深入分析这些动态,并提供详细的步骤指南,帮助读者更好地理解和应对相关变化。 1. 根服务器的基本概念 根服务器是互联网域名系统(DNS)中最顶层的服2026年2月11日 -

美国服务器站群:最佳的SEO选择

美国服务器站群:最佳的SEO选择 在当今数字化时代,搜索引擎优化(SEO)对于网站的成功至关重要。选择适合的服务器托管服务是实现有效SEO策略的关键因素之一。本文将重点介绍美国服务器站群作为最佳的SEO选择,并解释其在提高网站排名和用户体验方面的优势。 服务器站群是一种将网站托管在多个服务器上的技术。每个服务器都位于不同的地理位2025年2月11日 -

美国10G口服务器:高速稳定的网络连接解决方案

美国10G口服务器:高速稳定的网络连接解决方案 在现今数字化时代,网络连接的速度和稳定性对于个人和企业来说至关重要。为满足用户对高速稳定网络连接的需求,美国推出了10G口服务器,提供了解决方案。 10G口服务器是一种高速网络连接的服务器,它提供10Gbps的传输速度。相比传统的1Gbps服务器,10G口服务器具有更快的下载和上传2025年2月13日 -

我们的服务器都在美国吗 如何选择合适的云服务

在当今互联网时代,选择合适的云服务对于企业和个人来说至关重要。很多人都会问:“我们的服务器都在美国吗?”答案并不简单,因为不同的云服务提供商有不同的服务器位置和服务方案。在这篇文章中,我们将探讨如何选择最佳、最便宜的云服务,并评测市面上几款流行的云服务产品,帮助您做出明智的选择。 在选择云服务之前,首先需要了解不同类型的云服务。主要有以下几种类型:2025年12月1日 -

美国云服务器租用托管价格模型与成本优化技巧

概述:最好、最佳与最便宜的选择 在选择美国云服务器进行租用或托管时,很多企业会在“最好(性能/稳定)”与“最便宜(成本最低)”之间权衡。最好的通常是高可用、多可用区部署并购买专业托管服务;而最便宜的常见于使用按需+Spot 实例或最低配置的共享 VPS。理解价格模型与资源构成,是实现成本优化的前提。 主要价格模型 美国云厂商的价格模型常见四类2026年3月31日 -

美国高防服务器便宜

美国高防服务器便宜 在互联网时代,服务器是网站运行的核心。高防服务器是一种能够有效抵御各种外部攻击的服务器,对于需要保护网站安全的用户来说尤为重要。美国作为全球科技发展的主要国家之一,拥有众多高品质的服务器供应商,其高防服务器在性能、稳定性和安全性方面表现出色。 美国高防服务器具有以下优势: 价格便宜:相对于其他国家,美国的高防服2025年3月19日 -

无限云美国服务器托管的特点与使用场景

1. 无限云美国服务器托管的基本概念 无限云美国服务器托管是一种将网站或应用程序托管在美国的云服务器上的服务。 这种托管方式可以为用户提供高性能、稳定性和安全性。 随着云计算技术的发展,越来越多的企业选择将其业务迁移到云服务器上。 无限云作为一家知名的云服务提供商,其美国服务器托管服务具有多种优势2025年11月14日 -

LOL美国服务器的性能与玩家体验评测

随着《英雄联盟》(LOL)在全球范围内的流行,选择一个稳定且高性能的游戏服务器显得尤为重要。尤其是对于在美国地区的玩家来说,服务器的性能直接影响到游戏的流畅度和体验。本文将对LOL美国服务器的性能与玩家体验进行全面评测,并推荐一些合适的技术服务。 首先,LOL的服务器性能主要体现在延迟(Ping值)、数据包丢失率和带宽等几个方面2025年8月24日